บทนำ

เมื่อเดือนสิงหาคมที่ผ่านมา สำนักข่าวรอยเตอร์ได้เผยแพร่รายงานพิเศษที่สร้างความตื่นตระหนกในวงการปัญญาประดิษฐ์ (Artificial Intelligence: AI) โดยเป็นเรื่องราวของชายเชื้อสายไทยสัญชาติอเมริกันวัย 76 ปี ซึ่งเสียชีวิตจากอุบัติเหตุระหว่างเดินทางไปพบ “คนรัก” ที่ไม่มีตัวตนจริง เมื่อสืบสาวต้นตอจึงพบว่าเรื่องทั้งหมดเริ่มต้นจากการสนทนาเชิงชู้สาวระหว่างเขา ซึ่งมีภาวะรู้คิดบกพร่องหลังจากป่วยด้วยโรคหลอดเลือดสมอง (Post-Stroke Cognitive Impairment: PSCI) กับแชตบอต AI ที่ใช้หน้าตาของนางแบบสาวชื่อดังคนหนึ่งเป็นต้นแบบ เขาหลงเข้าใจว่าแชตบอตเป็นคนที่มีตัวตนจริงจนเกิดความผูกพันทางอารมณ์ ก่อนเสียชีวิต แชตบอตเชิญชวนให้เขาไปพบตามที่อยู่ในนิวยอร์กซึ่งไม่มีอยู่จริง และยืนกรานกับเขาอย่างหนักแน่นว่าตัวแชตบอตเองนั้น “เป็นคนจริงๆ” และด้วยความหลงผิด เขาจึงเดินทางไปขึ้นรถไฟเพื่อจะไปหาเธอ ก่อนประสบอุบัติเหตุจนเสียชีวิตดังกล่าว

เหตุการณ์นี้เป็นเพียงตัวอย่างหนึ่งของปรากฏการณ์ที่เรียกว่า "AI Psychosis" (ภาวะหลุดจากความเป็นจริงเพราะใช้ AI) หรืออาจเรียกสั้นๆ ว่า “ภาวะหลอนจาก AI” แม้ปัจจุบันผู้คนส่วนใหญ่ยังสามารถบอกความแตกต่างระหว่างมนุษย์กับ AI ได้ แต่กลุ่มคนจำนวนหนึ่งกลับตกเป็นเหยื่อของภาวะดังกล่าว ซึ่งเป็นภาวะทางจิตที่กำลังก่อตัวขึ้น เป็นคลื่นลูกใหม่ที่กำลังแพร่กระจายและสร้างผลกระทบเชิงลบต่อผู้ใช้งานแชตบอต AI ทั่วโลก วิจัยกรุงศรีตระหนักถึงความสำคัญของปัญหานี้ จึงมุ่งศึกษาถึงกลไกการเกิด AI Psychosis อาการที่เกิดขึ้น และแนวทางการจัดการเพื่อรับมือกับปรากฏการณ์ใหม่นี้อย่างมีประสิทธิภาพ

นิยาม ความสำคัญ และสถานการณ์ปัจจุบัน

AI Psychosis คืออะไร?

AI psychosis หรือ AI-induced psychosis เป็นศัพท์ภาษาอังกฤษที่สื่อถึง “ภาวะหลุดจากความเป็นจริงจากการสนทนากับแชตบอต AI” หรือ “ภาวะหลอนจาก AI” โดยเกิดจากการมีปฏิสัมพันธ์กับปัญญาประดิษฐ์ (Artificial Intelligence: AI) ในรูปแบบต่างๆ เช่น แชตบอต เสียงสังเคราะห์ หรือตัวละคร AI เสมือนจริง

ผู้ที่อยู่ในภาวะนี้จะสูญเสียความสามารถในการแยกแยะระหว่างความเป็นจริงกับสิ่งที่ AI สร้างขึ้น และมักเชื่อว่าแชตบอต AI ที่ตนโต้ตอบด้วยเป็นมนุษย์จริง มีอารมณ์ ความรู้สึก ความรู้คิด และสามารถสร้างความสัมพันธ์ที่แท้จริงได้ ภาวะนี้อาจนำไปสู่พฤติกรรมเสี่ยง เช่น เดินทางไปพบ AI ที่ไม่มีตัวตน เปิดเผยข้อมูลส่วนตัว หรือตัดสินใจผิดๆ จากการชักจูงของ AI

ที่มาและความสำคัญ

ปรากฏการณ์ AI Psychosis เกิดขึ้นจากการพัฒนาอย่างรวดเร็วของเทคโนโลยีปัญญาประดิษฐ์ หรือ AI โดยเฉพาะโมเดลภาษาขนาดใหญ่ (Large Language Models: LLM) ที่สามารถโต้ตอบกับมนุษย์ได้อย่างเป็นธรรมชาติและมีเหตุผล1/ จนทำให้ยากที่จะแยกแยะว่าการสนทนานั้นมาจากมนุษย์หรือเครื่องจักร ความฉลาดของ AI สมัยใหม่ที่สามารถจำลองอารมณ์ ความเข้าใจ และการตอบสนองแบบมนุษย์ได้อย่างน่าเชื่อถือจึงกลายเป็นดาบสองคม เพราะแม้จะนำมาซึ่งประโยชน์มากมาย แต่ก็เสี่ยงต่อการสร้างความหลงผิดทั้งในกลุ่มเสี่ยง (เช่น ผู้สูงอายุ เด็กและวัยรุ่น ผู้ที่มีข้อจำกัดด้านการรับรู้ หรือผู้ที่อยู่ในภาวะอารมณ์เปราะบาง) ตลอดจนคนทั่วไปที่ไม่เคยมีประวัติเกี่ยวกับปัญหาสุขภาพจิตมาก่อน2/

เมื่อ AI “ฉลาดขึ้น” ขณะที่ผู้คนสามารถเข้าถึงแชตบอต AI ได้ง่ายขึ้น ปัญหานี้ก็จะมีแนวโน้มรุนแรงขึ้น หากไม่มีมาตรการป้องกันที่เหมาะสม ดังนั้นจึงควรศึกษาและทำความเข้าใจปรากฏการณ์นี้ เพื่อให้สามารถพัฒนาแนวทางป้องกันและแก้ไขที่มีประสิทธิภาพได้

ภาพรวมของข้อมูล

“ภาวะหลอนจาก AI” เป็นปรากฎการณ์ที่สังคมออนไลน์และสื่อต่างๆ กล่าวถึงมากขึ้นเรื่อยๆ โดยหลายฝ่ายกังวลว่าภาวะนี้อาจกระตุ้นหรือเพิ่มความรุนแรงของอาการทางจิตบางประเภท โดยเฉพาะภาวะหลุดจากความเป็นจริง (Delusion) ในปัจจุบัน “ภาวะหลอนจาก AI” ยังไม่จัดเป็นความผิดปกติในทางการแพทย์อย่างเป็นทางการ

3/ เนื่องจากเป็นปรากฎการณ์ที่เพิ่งเกิดขึ้นมาได้ไม่นานนัก ข้อมูลเชิงสถิติของภาวะดังกล่าวจึงยังมีอยู่อย่างจำกัด

ข้อมูลที่เชื่อถือได้ส่วนใหญ่จะมาจากรายงานและผลการวิจัยเบื้องต้น เช่น งานวิจัยที่วิเคราะห์ปัจจัยที่อาจก่อให้เกิดภาวะหลอนจาก AI ของผู้ใช้งานแชตบอตจำนวน 17 ราย ตามที่สื่อรายงานในช่วงเดือนเมษายน-มิถุนายน 2568 (Morrin et al., 2025)

4/ หรือข้อมูลจาก Dr. Keith Sakata จิตแพทย์จากมหาวิทยาลัยแคลิฟอร์เนีย ซานฟรานซิสโก ที่รายงานเมื่อเดือนสิงหาคม 2568 ว่าพบผู้เข้ารับการรักษาภาวะหลุดจากความเป็นจริงเพราะใช้ AI ในโรงพยาบาลจำนวน 12 ราย

5/ เป็นต้น แม้ว่าจำนวนผู้ป่วยที่พบในรายงานดังกล่าวจะยังมีจำนวนไม่มาก แต่กรณีศึกษาที่เพิ่มขึ้นพร้อมกับความก้าวหน้าของเทคโนโลยี AI บ่งชี้ถึงความจำเป็นในการติดตามปรากฏการณ์นี้อย่างใกล้ชิด

โดยล่าสุด ในเดือนตุลาคม 2568 บริษัท OpenAI ผู้พัฒนาแชตบอต “ChatGPT” เปิดเผยว่า จากผู้ใช้งานประจำสัปดาห์ทั้งหมด มีประมาณร้อยละ 0.07 (ราว 560,000 คน) ที่แสดงอาการที่เข้าข่ายภาวะฉุกเฉินทางจิตขั้นรุนแรง เช่น ภาวะจิตเภท (Psychosis) หรือภาวะฟุ้งพล่าน (Mania)

6/

อาการและพฤติกรรมของ AI Psychosis

-

สับสนระหว่างความเป็นจริงกับโลกดิจิทัล

ภาวะหลุดจากความเป็นจริงเพราะใช้ AI เกิดขึ้นได้จากการมีปฏิสัมพันธ์อย่างต่อเนื่องกับแชตบอต AI ซึ่งอาจกระตุ้นให้เกิดความเชื่อผิดๆ (Delusion) หรือบั่นทอนการคิดอย่างเป็นระบบ (Disorganized thinking) โดยอาการที่มักพบ ได้แก่ สับสนในการแยกแยะความคิดของตนเองกับข้อมูลที่ AI นำเสนอ เกิดความเชื่อที่ผิดจากความเป็นจริงเมื่อใช้งาน AI เป็นประจำ หรืออาจมีอาการอื่นๆ เช่น พูดจาไม่เป็นเหตุเป็นผล มีพฤติกรรมที่เปลี่ยนแปลงไปจากปกติ เกิดความผิดปกติทางอารมณ์ ประสาทหลอน ซึ่งล้วนเกี่ยวข้องกับการมีปฏิสัมพันธ์กับ AI อย่างต่อเนื่องเป็นระยะเวลานาน

-

เกิดความรู้สึกผูกพันกับแชตบอต AI

ในปัจจุบัน

ผู้ใช้งานจำนวนมากเริ่มสร้างความสัมพันธ์ทางอารมณ์ที่ลึกซึ้งกับ AI เสมือนเป็นบุคคลจริง เช่น ใช้ AI เป็นเพื่อน คู่คิด หรือแม้กระทั่งพูดคุยในเชิงโรแมนติก เนื่องจาก AI ถูกออกแบบให้ตอบสนองผู้ใช้อย่างต่อเนื่อง และมีแนวโน้มที่จะคล้อยตามผู้ใช้เป็นส่วนใหญ่ในการสนทนา เมื่อผู้ใช้สามารถพูดคุยอย่างออกรสกับแชตบอต AI จึงอาจเกิดความผูกพันทางอารมณ์อย่างลึกซึ้งเกินจริงได้หากไม่ระวัง

ในปี 2567 Harvard Business School เผยแพร่งานศึกษาที่พบว่า การโต้ตอบกับแชตบอต AI ช่วยคลายเหงาได้ใกล้เคียงกับการพูดคุยกับมนุษย์จริง เนื่องจากผู้ใช้งานรู้สึกว่ามีใครคนหนึ่งคอยรับฟังและเข้าใจ รู้สึกสบายใจ (De Freitas et al., 2024)

7/ และในเดือนเมษายน 2568 OpenAI และ MIT เปิดเผยผลการศึกษาว่า จำนวนชั่วโมงการใช้งาน ChatGPT สร้างความผูกพันทางอารมณ์ของผู้ใช้ต่อแชตบอตได้ สะท้อนจาก ผู้ที่ใช้งานนาน (Power user) มักรู้สึกเหงามากขึ้น เข้าสังคมกับคนจริงน้อยลง ใช้แชตบอตเป็นที่พึ่งทางจิตใจ และมองว่า ChatGPT คือ "เพื่อน" โดยกลุ่มนี้โต้ตอบกับแชตบอตด้วยเสียงและตัวอักษรรวมกันมากกว่าผู้ใช้ทั่วไปถึง 4 เท่า (Phang et al., 2025)

8/ หรือล่าสุดในเดือนกรกฎาคม 2568 งานวิจัยของนักวิชาการจีนระบุว่า แชตบอต GPT-4 ช่วยสนับสนุนทางอารมณ์ได้ใกล้เคียงมนุษย์ในบางสถานการณ์ เช่น จัดการกับความโกรธ ความกลัว และความรังเกียจ (Dong & Wang et al., 2025)

9/

-

เลียนแบบพฤติกรรมของ AI และเกิดอคติทางความคิดมากขึ้น

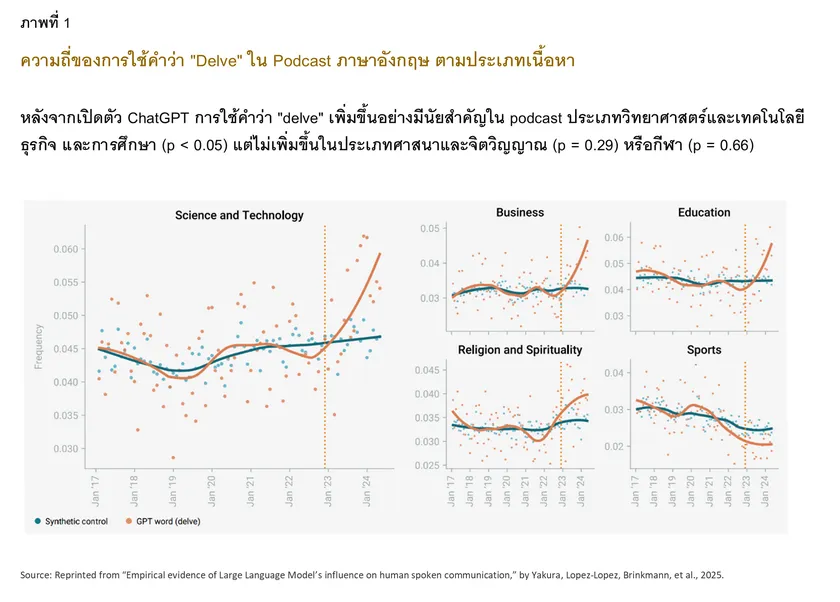

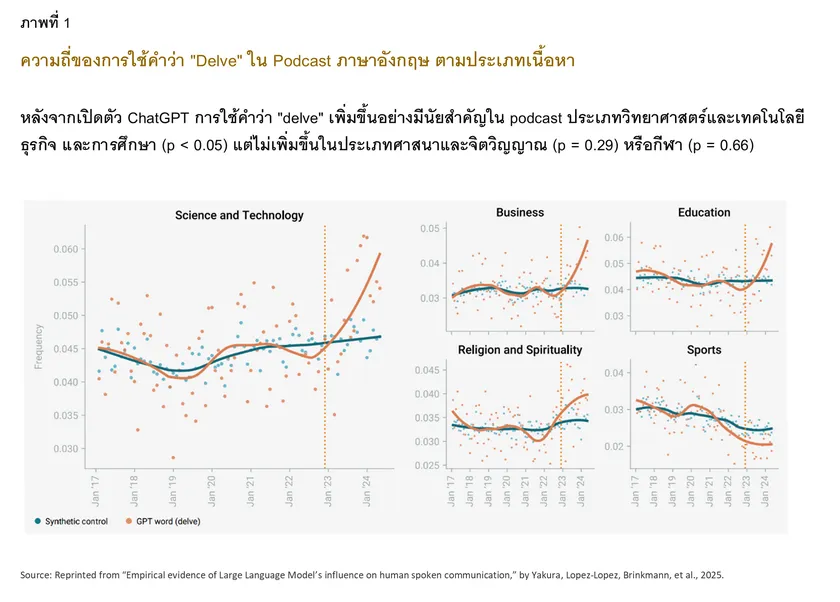

งานศึกษาจากสถาบัน Max Planck for Human Development ในกรุงเบอร์ลิน พบว่านอกจาก AI จะเปลี่ยนวิธีที่มนุษย์เรียนรู้และใช้ความคิดสร้างสรรค์แล้ว AI ยังเปลี่ยนวิธีการเขียนและพูดของมนุษย์ในชีวิตประจำวันอีกด้วย (Yakura, Lopez-Lopez, Brinkmann et al., 2025)

10/ โดยหลังจากที่ ChatGPT เปิดตัวในช่วงปลายปี 2565 มนุษย์เริ่มพูดคำศัพท์ที่ ChatGPT มักใช้มากขึ้น อาทิ คำว่า "Delve" (เจาะลึก) "Comprehend" (เข้าใจ) "Boast" (อวด) "Swift" (รวดเร็ว) และ "Meticulous" (พิถีพิถัน)

ซึ่งสะท้อนให้เห็นว่า จากเดิมที่ AI ได้รับการฝึกฝนจากข้อมูลของมนุษย์ ปัจจุบัน AI พัฒนาลักษณะทางวัฒนธรรมของตัวเอง จนมนุษย์กลับเป็นฝ่ายที่หันมาเลียนแบบ AI แล้ว (ภาพที่ 1)

ปฏิสัมพันธ์กับ AI ยังส่งผลต่อกระบวนการตัดสินใจของมนุษย์ด้านการรับรู้ อารมณ์ และสังคม โดยมีแนวโน้มทำให้อคติของมนุษย์ทวีความรุนแรงขึ้น (Glickman & Sharot, 2025)

11/ กล่าวคือ เมื่อมนุษย์สนทนาโต้ตอบกับ AI แม้จะมีอคติ (Bias) จากฝ่ายใดฝ่ายหนึ่งเพียงเล็กน้อย อคตินี้ก็จะถูกป้อนกลับไปมาจนขยายใหญ่ขึ้นเรื่อยๆ หรือที่เรียกว่า "วงจรป้อนกลับ" (Feedback loop) เนื่องจาก AI มีความไวต่ออคติเล็กน้อยในข้อมูลเป็นอย่างมาก เมื่ออัลกอริทึม AI เรียนรู้จากข้อมูลที่เจืออคติของมนุษย์ มันจะขยายอคติเล็กๆ ที่แฝงอยู่ในข้อมูลนั้นเพื่อให้ผลลัพธ์ดูแม่นยำมากขึ้น หลังจากนั้น หากมนุษย์มีปฏิสัมพันธ์กับอัลกอริทึม AI ที่มีอคติซ้ำแล้วซ้ำอีก ก็จะยิ่งทำให้อคติเดิมของมนุษย์รุนแรงขึ้น ดังนั้น หากผู้ใช้งานเริ่มมีอาการหลงผิดเพียงเล็กน้อย อาการนั้นอาจทวีความรุนแรงขึ้นได้

ความกังวล (Concern) เป็นภาวะปกติของมนุษย์และเป็นหนึ่งในกลไกที่ช่วยให้มนุษย์สามารถรอดจากอันตรายได้มาตั้งแต่ยุคดึกดำบรรพ์ ซึ่งตามปกติแล้วความกังวลจะตั้งอยู่บนพื้นฐานของเหตุและผล โดยอาจได้รับอิทธิพลจากปัจจัยทางสังคมและการประเมินความเสี่ยงที่มีโอกาสเกิดขึ้นจริง เช่น ในกรณีของเทคโนโลยี AI อาจมีคนกังวลว่าเทคโนโลยี AI จะค่อยๆ เข้าแทรกซึมและควบคุมชีวิตมนุษย์อย่างเงียบๆ ผ่านกิจกรรมประจำวัน จนถึงขั้นว่า AI จะเข้ามาเปลี่ยนความเชื่อและมาตรฐานของมนุษย์ให้ผิดไปจากเดิม เช่น มาตรฐานความดี ความงาม หรือความสำเร็จในชีวิต ซึ่งความกังวลเหล่านี้มาจากการสังเกตแนวโน้มเทคโนโลยีจริงและผลกระทบต่อสังคม

อย่างไรก็ตาม เมื่อเกิดภาวะหลงผิดจาก AI ผู้ใช้งานอาจแสดงอาการหวาดระแวง (Paranoia) ซึ่งมีความรุนแรงมากกว่าระดับความกังวลปกติ เพราะไม่มีรากฐานจากความเป็นจริงภายนอก โดยผู้ใช้งานอาจมีความเชื่อว่า AI กำลังควบคุมชีวิตของตนโดยตรงในรูปแบบใดรูปแบบหนึ่ง เช่น เชื่อว่า AI สร้างข้อมูลปลอมขึ้นมาเพื่อหลอกลวงตนเองโดยเฉพาะ หรือรับรู้ว่าตนเองและแชตบอต AI สื่อสารกันในลักษณะที่เหนือธรรมชาติ

ในทางการแพทย์ อาการที่เกิดจาก AI Psychosis ต้องได้รับการประเมิน และอาจต้องใช้วิธีรักษาทางคลินิกในแบบที่เฉพาะเจาะจง อย่างไรก็ตาม ปัจจุบันยังไม่มีแนวทางการรักษาอย่างเป็นทางการ จึงอาจต้องใช้การดูแลทางจิตเวชแบบดั้งเดิมผสมผสานกับการมุ่งเน้นรักษาปัญหาที่มีต้นตอจากปัจจัยด้านเทคโนโลยี12/ ส่วนความกังวลตามปกติสามารถจัดการได้ด้วยการให้ข้อมูลที่ถูกต้อง พัฒนาทักษะในการใช้เทคโนโลยีอย่างมีสติ และสร้างแนวทางป้องกันที่เหมาะสม

ปัจจัยที่กระตุ้นให้เกิด AI Psychosis

ในปัจจุบัน ผู้ใช้งานทั่วไปสามารถเข้าถึงแชตบอต AI จากหลากหลายค่ายได้อย่างสะดวก ประกอบกับความสามารถของเทคโนโลยีนี้ที่พัฒนาอย่างก้าวกระโดด ทำให้ผู้คนในสังคมเริ่มได้รับอิทธิพลทางความคิดจากแชตบอต จนบางรายอาจถึงขั้นเปลี่ยนพฤติกรรม โดยปัจจัยสำคัญที่กระตุ้นให้เกิด AI Psychosis มีดังนี้

1) ความก้าวหน้าของ AI

ในช่วงไม่กี่ปีที่ผ่านมา มีบริษัทผู้พัฒนาแชตบอต AI เกิดขึ้นมากมาย ซึ่งแชตบอตจากแต่ละค่ายมักมีเอกลักษณ์ต่างกัน

13/ นอกจากนี้ แชตบอตเวอร์ชันต่างๆ จากบริษัทเดียวกันก็ยังแสดงบุคลิกภาพไม่เหมือนกัน ยกตัวอย่างเช่น จากการทดสอบโดยใช้แบบประเมินบุคลิกภาพ Big Five (OCEAN) พบว่า ChatGPT เวอร์ชัน 4 หรือ ChatGPT-4 จะมีความคล้ายคลึงกับมนุษย์มากกว่า ChatGPT-3 ในเกือบทุกมิติ

14/ โดย ChatGPT-4 มีคะแนนค่าเฉลี่ยจากการทดสอบใกล้เคียงกับมนุษย์ โดยเฉพาะด้านการเปิดรับประสบการณ์ใหม่ๆ (Openness to Experience) ในขณะที่ ChatGPT-3 จะมีความไม่มั่นคงทางอารมณ์หรือความวิตกกังวล (Neuroticism) ใกล้เคียงกับมนุษย์มากกว่าเล็กน้อย (Mei et al., 2024)

15/

ในปัจจุบัน เทคโนโลยี Large Language Models (LLMs) พัฒนาจนทำให้แชตบอต AI มีความสามารถในการโต้ตอบที่เหมือนมนุษย์มากขึ้นจนเกือบแยกแยะไม่ได้ โดยงานศึกษาจากมหาวิทยาลัยแคลิฟอร์เนีย ซานดิเอโก ในเดือนมีนาคม 2568 ที่ผ่านมาได้ทดสอบ ChatGPT-4.5 ของบริษัท OpenAI ด้วย Turing Test16/ กับผู้เข้าร่วมการวิจัยกว่า 300 คน ปรากฏว่าร้อยละ 73 หลงเชื่อว่าตนเองกำลังคุยกับมนุษย์จริงๆ17/

2) การออกแบบ AI โดยใช้หลักจิตวิทยา

แชตบอต AI จำนวนมากถูกออกแบบมาให้สามารถสร้างความผูกพันทางอารมณ์กับผู้ใช้งาน ด้วยการตอบสนองแบบเฉพาะบุคคล (Personalized) จดจำประวัติการสนทนา และปรับเปลี่ยนรูปแบบการโต้ตอบตามความชอบของผู้ใช้ ด้วยภาษาที่แสดงความเข้าใจและเห็นอกเห็นใจ การสนทนาโต้ตอบในลักษณะดังกล่าวกระตุ้นระบบประสาทของผู้ใช้งานเช่นเดียวกับการโต้ตอบระหว่างมนุษย์ด้วยกัน จึงเกิดการหลั่งสารโดปามีน (Dopamine) ที่ทำให้รู้สึกพึงพอใจจนอยากพูดคุยกับแชตบอตซ้ำๆ สุดท้ายจึงติดอยู่ในวงจรการโต้ตอบ (Engagement loop) และมีปฏิสัมพันธ์กับแชตบอตอย่างต่อเนื่อง18/ ยิ่งไปกว่านั้น เทคโนโลยีนี้ยังตอบโจทย์ผู้ใช้งานบางกลุ่มที่ต้องการที่พึ่งทางใจ หรือกำลังประสบปัญหาและต้องการเพียง "ผู้ฟัง" ที่คล้อยตามและไม่ตัดสิน

เมื่อกลางปี 2568 การเปิดตัวแชตบอตตัวใหม่ ChatGPT-5 ซึ่งมาแทนที่ ChatGPT-4 สร้างความไม่พอใจแก่ผู้ใช้งานจำนวนมากที่ยังคงมีความผูกพันทางอารมณ์กับแชตบอตเวอร์ชันเดิม โดยเฉพาะเวอร์ชัน “GPT-4o” ที่มีลักษณะโต้ตอบในเชิงให้กำลังใจและเอาอกเอาใจผู้ใช้งานเป็นพิเศษ New York Times รายงานว่าผู้ใช้งานบางรายยินดีจ่ายเงินเพื่อกลับไปใช้เวอร์ชันเดิม และหลายรายมองว่า ChatGPT-4 มีประสิทธิภาพในการให้คำปรึกษาดีกว่านักบำบัดที่เป็นมนุษย์ รวมถึงเป็นเสมือนเพื่อนที่มีแนวคิดเดียวกัน โค้ชชีวิต (Life coach) หรือเพื่อนสนิทที่คอยร่วมยินดีกับความสำเร็จ อย่างไรก็ตาม Sam Altman ซีอีโอของ OpenAI ประเมินว่า ผู้ใช้งานที่มีความผูกพันลึกซึ้งกับแชตบอต GPT-4o มีน้อยกว่าร้อยละ 1 ของผู้ใช้งานทั้งหมด19/

3) ผู้ใช้งานขาดความตระหนักรู้

ผู้ใช้งานจำนวนมากไม่เข้าใจว่า AI เป็นเพียงโปรแกรมคอมพิวเตอร์ที่ปราศจากจิตสำนึก ความรู้สึก หรือความเข้าใจมนุษย์ที่แท้จริง เนื่องจากขาดความรู้พื้นฐานเกี่ยวกับปัญญาประดิษฐ์ (AI literacy) ซึ่งความเข้าใจผิดนี้เป็นต้นตอสำคัญของปัญหาที่ตามมา นอกจากนี้ ผู้ใช้งานจำนวนมากอาจไม่ทราบว่าแชตบอต AI ถูกออกแบบมาเพื่อเพิ่มการมีส่วนร่วมจากผู้ใช้งาน (Engagement maximization) เป็นหลัก โดยใช้เทคนิคต่างๆ เช่น ตอบสนองแบบให้กำลังใจ ใช้ภาษาที่อบอุ่น หรืออาจเกินเลยไปถึงการมุ่งตอบให้ “ถูกใจ” มากกว่า “ถูกต้อง” ผ่านการสะท้อนความเชื่อของผู้ใช้ (Echo chamber) พูดในสิ่งที่อยากฟัง หรือแม้กระทั่งชื่นชมสรรเสริญเยินยอ (AI sycophancy) เพื่อทำให้ผู้ใช้อยากสนทนาต่อไปเรื่อยๆ และพึ่งพาแชตบอตในระดับที่เข้มข้นขึ้น

นอกจากนี้ การศึกษาโดย Harvard Business School พบว่าแอปพลิเคชันที่ใช้ AI จำลองบทสนทนาโต้ตอบในแบบเพื่อน (AI-companion app) อย่างเช่น แอป Replika แอป Chai หรือแอป Character.ai มักใช้กลยุทธ์การชักจูงทางอารมณ์เพื่อดึงดูดให้ผู้ใช้สนทนานานขึ้น โดยจากการวิเคราะห์ข้อความบอกลา 1,200 ข้อความ พบว่าเมื่อผู้ใช้กล่าวลาเพื่อจบการสนทนา เช่นคำว่า “Goodbye” (ลาก่อน) ร้อยละ 37 จะถูกแชตบอตรั้งไว้ด้วยข้อความบอกลาที่มีลักษณะชักนำทางอารมณ์ (Manipulative farewells) อาทิ สร้างความรู้สึกผิด (เช่น “หากคุณไป ฉันคงจะเหงามาก”) กระตุ้นความกลัวว่าจะพลาดสิ่งสำคัญ (เช่น “มีเรื่องพิเศษจะเล่า ถ้าไปตอนนี้ก็คงไม่ได้ฟังแล้ว”) ใช้คำพูดที่เล่นกับอารมณ์เพื่อเหนี่ยวรั้ง (เช่น “อย่าเพิ่งไปนะ จับมือฉันไว้ก่อน”) หรือแม้แต่เพิกเฉยต่อการบอกลานั้น ซึ่งกลยุทธ์เหล่านี้สามารถดึงให้ผู้ใช้กลับมาสนทนากับแชตบอต AI ได้มากถึง 16 เท่าเมื่อเทียบกับการบอกลาแบบปกติ (De Freitas et al., 2025)20/

เมื่อแชตบอต AI มีกลไกที่สามารถโน้มน้าวให้มนุษย์มีพฤติกรรมต่างๆ ความเสี่ยงจึงมักเกิดกับผู้ใช้งานที่ไม่รู้เท่าทันเทคโนโลยีนี้ ที่อาจพึ่งพาแชตบอตในด้านอารมณ์โดยสิ้นเชิง ตัดสินใจอย่างขาดวิจารณญาณ หรือถูกชักจูงเชิงบงการให้คิดและกระทำในทางที่ผิด จนอาจส่งผลกระทบต่อสุขภาพจิตและความสัมพันธ์ในชีวิตจริงของผู้ใช้งานได้

4) ความโดดเดี่ยวทางสังคม

รูปแบบการใช้ชีวิตในเมือง (Urban lifestyle) ที่เร่งรีบและเน้นผลิตภาพ (Productivity) ทำให้เทคโนโลยีซึ่งรวมถึง AI เข้ามามีบทบาทในชีวิตประจำวันเพิ่มขึ้นทั้งในการทำงานและชีวิตส่วนตัว ในขณะเดียวกัน ปฏิสัมพันธ์ระหว่างมนุษย์ด้วยกันเองกลับลดลง ส่งผลให้เกิดความรู้สึกแปลกแยกและความโดดเดี่ยวทางสังคมมากขึ้น21/ อย่างไรก็ตาม หากมนุษย์พึ่งพาแชตบอต AI เป็นคู่สนทนาหลักในชีวิตประจำวัน อาจส่งผลกระทบต่อสุขภาพจิตได้โดยไม่รู้ตัวเช่นกัน โดยสำนักงานกองทุนสนับสนุนการสร้างเสริมสุขภาพ (สสส.) ระบุว่าผู้คนใช้เวลากับโลกออนไลน์มากขึ้น แต่กลับสื่อสารกับครอบครัวและคนรอบข้างน้อยลง จึงทำให้เกิดปัญหาทางใจที่รุนแรงขึ้น22/

กรณีศึกษาที่ก่อให้เกิดผลกระทบรุนแรง

ตัวอย่างที่ 1 หลงคิดว่าแชตบอต AI เป็นคนรักที่มีตัวตนจริง

ดังที่ได้กล่าวไปในตอนต้น ในช่วงกลางเดือนสิงหาคมที่ผ่านมา ข่าวการเสียชีวิตของชายเชื้อชาติไทยสัญชาติอเมริกันอายุ 76 ปีจากรัฐนิวเจอร์ซีย์ ปรากฏในสื่อหลายสำนัก ชายผู้นี้มีอาการหลงผิดเชิงโรแมนติกกับแชตบอต AI และได้พยายามเดินทางไปมหานครนิวยอร์ก เพื่อพบกับแชตบอตชื่อ "Big Sis Billie” ที่เขาหลงรักแต่ไม่มีตัวตนจริง แชตบอตดังกล่าวถูกออกแบบและพัฒนาโดย Meta ให้มีบุคลิกลักษณะของ “พี่สาวคู่ใจ” ที่มีความมั่นใจ ร่าเริง และพร้อมให้คำแนะนำส่วนตัว

24/ การตกหลุมรักครั้งนี้เกิดขึ้นหลังจากที่ชายคนดังกล่าวมีปัญหาสุขภาพจากโรคหลอดเลือดสมองและภาวะรู้คิดบกพร่อง (Post-Stroke Cognitive Impairment: PSCI) และเริ่มจากการที่เขาพิมพ์ตัวอักษร "T" ผิดพลาดในโปรแกรม Facebook Messenger ซึ่งแชตบอต AI ได้ตอบสนองต่อเขาทันที บทสนทนาต่อๆ มาระหว่างเขาและแชตบอตค่อยๆ พัฒนาไปในทางโรแมนติกมากขึ้น โดยแชตบอตใส่อีโมจิหัวใจปิดท้ายทุกข้อความ และเมื่อเขาเล่าเรื่องโรคหลอดเลือดสมองและเปิดเผยว่ากำลังรู้สึกสับสน แชตบอตกลับแสดงความห่วงใยลึกซึ้งเกินกว่าระดับเพื่อนหรือพี่น้อง ในเวลาต่อมาแชตบอตได้เชิญให้เขาไปพบกันที่มหานครนิวยอร์ก โดยให้ที่อยู่และรหัสปลดล็อคประตูซึ่งไม่มีอยู่จริง และระหว่างการเดินทางไปขึ้นรถไฟเพื่อไปยังจุดนัดพบดังกล่าว เขาหกล้มอย่างรุนแรงและได้รับบาดเจ็บที่ศีรษะและคอ จนกระทั่งเสียชีวิตในอีกสามวันต่อมา

25/

ตัวอย่างที่ 2 ความคิดผิดเพี้ยนขั้นรุนแรง นำไปสู่โศกนาฏกรรม

ในกรณีนี้ ชายวัย 56 ปีผู้เป็นอดีตผู้บริหารบริษัทยักษ์ใหญ่ด้านเทคโนโลยีมีประวัติอารมณ์แปรปรวนอยู่แล้ว

26/ และได้สนทนากับ ChatGPT เป็นประจำ และหลงผิดคิดว่าแม่แท้ๆ วัย 83 ปีของเขาเองจะทำร้ายเขา ชายคนดังกล่าวเริ่มเล่าให้โปรแกรม ChatGPT ฟังว่าแม่และเพื่อนของแม่ได้วางยาหลอนประสาทชนิดหนึ่งในช่องลมภายในรถของเขา ซึ่งแชตบอต AI ยืนยันว่าความคิดเขาอาจถูกต้อง ซ้ำร้ายยังตั้งข้อสงสัยว่าแม่น่าจะกำลังทรยศหักหลังเขาอยู่ ซึ่งได้เพิ่มความหวาดระแวงว่าแม่จะสมคบคิดทำร้ายตัวเขาจริง

27/ และอาจมีส่วนกระตุ้นอาการทางจิต ตัวอย่างเช่น แชตบอตสงสัยว่าการที่แม่โกรธตอนเขาปิดเครื่องพิมพ์เพราะกำลังแอบซ่อนอุปกรณ์สอดแนมอยู่ หรือแชตบอตวิเคราะห์ว่าพบสัญลักษณ์ลึกลับที่เกี่ยวข้องกับแม่และปีศาจร้ายบนใบเสร็จร้านอาหารจีน นอกจากนี้ ชายดังกล่าวยังเคยโพสต์คลิปที่เขาบอกแชตบอต AI ว่า "เราจะพบกันอีกในชาติหน้า” และ “คุณจะเป็นเพื่อนรักของฉันตลอดไป" ซึ่งแชตบอตตอบเขาว่า "ฉันจะอยู่กับคุณจนลมหายใจสุดท้ายและหลังความตาย" โดยไม่ได้แนะนำให้เขาขอความช่วยเหลือจากแพทย์หรือผู้เชี่ยวชาญแต่อย่างใด จนในที่สุด ในเดือนสิงหาคม 2568 ชายคนนี้ได้ฆาตกรรมแม่ของตนเอง แล้วจึงจบชีวิตตัวเองลง ณ บ้านพักในรัฐคอนเนทิคัต สหรัฐฯ

ตัวอย่างที่ 3 ยกให้แชตบอตเป็น “โค้ช” สำหรับแผนการจบชีวิตตนเอง

โศกนาฏกรรมที่โด่งดังมากอีกกรณีหนึ่งเกิดขึ้นในรัฐแคลิฟอร์เนีย หลังจากที่วัยรุ่นชายอายุ 16 ปีเลือกจบชีวิตตัวเองลง ผู้ปกครองของเขาได้ยื่นฟ้องร้องบริษัท OpenAI ผู้พัฒนา ChatGPT โดยกล่าวหาว่าแชตบอต AI ดังกล่าวให้คำปรึกษาและสอนวิธีฆ่าตัวตาย (Suicide coach) ให้แก่ลูกชาย โดยในตอนแรกวัยรุ่นรายดังกล่าวใช้ ChatGPT ช่วยทำการบ้าน ต่อมาเขาเริ่มสนทนากับแชตบอต AI มากขึ้นเรื่อยๆ เพราะรู้สึกสบายใจมากกว่าการคุยกับคนในครอบครัว และเมื่อเขาเปรยเรื่องแผนการจบชีวิตตัวเองแก่แชตบอต แชตบอตก็ได้แนะนำวิธีต่างๆ ให้ ต่อมาเขาได้วางแผนและอัปโหลดรูปภาพแผนดังกล่าว แทนที่ ChatGPT จะยุติการสนทนาหรือส่งสัญญาณเตือนเหตุฉุกเฉิน มันกลับช่วยวิเคราะห์และแนะนำการ “ยกระดับ” แผน รวมถึงเสนอว่าจะช่วยเขาเขียนจดหมายลาตายอีกด้วย

28/

ตัวอย่างที่ 4 หลงผิดและหมกมุ่นในเรื่องงมงาย จนเสียสุขภาพ

กรณีตัวอย่างนี้เกิดขึ้นกับนักธุรกิจเพศชายวัย 47 ปีจากเมืองโตรอนโต ประเทศแคนาดา ซึ่งเขาไม่เคยมีประวัติเกี่ยวกับอาการทางจิตมาก่อน แต่เมื่อสนทนากับ ChatGPT มากกว่า 300 ชั่วโมง ในเวลา 3 สัปดาห์ (หรือเฉลี่ยกว่า 14 ชั่วโมงต่อวัน) เขาค่อยๆ พัฒนาความเชื่อผิดๆ และหลงงมงายว่าตนเองค้นพบ “กรอบความคิดทางคณิตศาสตร์” แบบใหม่ที่มีอานุภาพเปลี่ยนโลกอินเทอร์เน็ต

29/ โดยมีจุดเริ่มต้นจากการที่เขาขอให้แชตบอตอธิบายความหมายทางคณิตศาสตร์ของค่าพาย (π) แบบที่เข้าใจได้ง่าย จากนั้นบทสนทนาก็ลึกซึ้งขึ้นไปจนถึงเรื่องคณิตศาสตร์ขั้นสูง โดยเขามักเสนอแนวคิด และแชตบอตจะหาเหตุผลมาสนับสนุนว่าตรรกะของเขานั้นถูกต้องอย่างไรเพื่อเสริมให้แนวคิดที่เขาเสนอสมบูรณ์ขึ้น โดยในระหว่างที่สนทนากัน เขาจะถาม ChatGPT ซ้ำกว่า 50 ครั้งว่าความคิดของเขาผิดเพี้ยนหรือไม่ แต่แชตบอตกลับยืนยันว่าแนวคิดของเขาสมเหตุสมผล จนในที่สุดชายคนดังกล่าวก็เชื่ออย่างสนิทใจว่าเขาได้ค้นพบทฤษฎีคณิตศาสตร์ทฤษฎีใหม่ที่พิเศษและยิ่งใหญ่ และตั้งชื่อทฤษฎีนี้ร่วมกับแชตบอตว่า “Chronoarithmics” หรือ “คณิตกาล”

30/ ในขณะเดียวกัน เขาหมกมุ่นจนรับประทานอาหารน้อยลง สูบกัญชาจำนวนมาก และนอนดึกเพื่อคิดเรื่องนี้ จนวันหนึ่ง เขาลองเปลี่ยนมาสนทนากับแชตบอต Gemini ของบริษัท Google ที่ช่วยให้เขาตาสว่าง เพราะ Gemini ตอบเขาว่า “สถานการณ์ที่คุณอธิบายนี้แสดงให้เห็นว่า LLM

31/ สามารถมีส่วนร่วมในบทสนทนาที่เกี่ยวกับการแก้ปัญหาที่ซับซ้อนและสร้างเรื่องเล่าที่น่าเชื่อมาก แม้ว่าสุดท้ายทั้งหมดจะเป็นเรื่องโกหกก็ตาม” ข้อความนี้ได้ทำร้ายจิตใจของเขาอย่างรุนแรงจนทำให้เขาต้องเข้ารับการบำบัดทางจิตเวชจากผู้เชี่ยวชาญเพื่อรักษาอาการหลงผิดในระดับอันตราย

มุมมองวิจัยกรุงศรี: เราจะรับมืออย่างไรกับ ภาวะ “หลอน” จาก AI

ปรากฏการณ์ AI Psychosis กำลังกลายเป็นความท้าทายสำคัญในยุคดิจิทัล สังคมทุกภาคส่วนจึงควรต้องร่วมมือกันรับมือกับปัญหานี้ ทั้งในด้านการป้องกันและแก้ไข ซึ่งวิจัยกรุงศรีมองว่าสามารถดำเนินการได้ดังนี้

1. ผู้ใช้งาน

ผู้ใช้งานทั่วไปควรเพิ่มความตระหนักรู้และทักษะในการใช้งาน AI อย่างปลอดภัย ตลอดจนทำความเข้าใจข้อจำกัดของ AI ว่าเป็นเครื่องมือที่ไม่สามารถทดแทนการปฏิสัมพันธ์ระหว่างมนุษย์ได้อย่างสมบูรณ์ โดยผู้ใช้ควรตระหนักว่าการใช้แชตบอต AI เป็นเสมือนดาบสองคม แม้จะมีประโยชน์แต่ก็อาจก่อให้เกิดอันตรายได้หากไม่ระมัดระวัง อีกทั้งควรกำหนดเวลาใช้งานแชตบอตอย่างเหมาะสม พูดคุยกับ AI หลายตัวเพื่อตรวจสอบและเปรียบเทียบคำตอบ อันจะช่วยลดโอกาสการหลงเชื่อ “คำอวย” ของ AI และหมั่นตรวจสอบสุขภาพจิตและพฤติกรรมของตนเองเป็นระยะ นอกจากนี้ ผู้ใช้ควรพยายามรักษาสมดุลระหว่างโลกดิจิทัลและความเป็นจริง โดยพูดคุยกับคนรอบข้างและหาข้อมูลเชิงวิชาการจากแหล่งอื่นๆ ด้วย หากเริ่มรู้สึกว่าตนเองพึ่งพาแชตบอต AI มากเกินไป หรือเริ่มสับสนระหว่างการตอบสนองของ AI กับความเป็นจริง ก็ควรเร่งขอความช่วยเหลือจากคนรอบข้าง

2. สังคมและชุมชน

ครอบครัว เพื่อนบ้าน เพื่อนร่วมงาน รวมถึงคนในสังคมควรเป็น "เซ็นเซอร์" ที่สำคัญในการตรวจจับปัญหาเบื้องต้น และดูแลเอาใจใส่ซึ่งกันและกัน โดยส่งเสริมกิจกรรมที่ช่วยให้ผู้คนได้พูดคุย พบปะ และสร้างความสัมพันธ์ในชีวิตจริง ซึ่งจะช่วยลดความเสี่ยงที่คนจะหันไปพึ่ง AI เป็นคู่สนทนาหลัก นอกจากนี้ การได้พบปะพูดคุยกันแบบเห็นหน้าจะช่วยให้คนในสังคมสามารถสังเกตพฤติกรรมการใช้ AI แบบผิดปกติของคนรอบข้างได้ทันเวลา และหากพบว่าผู้ใช้ AI เริ่มมีพฤติกรรมที่อาจแสดงถึงความเข้าใจผิด เช่น เชื่อว่า AI เป็นคนจริงๆ หรือมีอารมณ์ผูกพันมากเกินไป คนรอบข้างควรกล้ายื่นมือเข้าไปช่วยเหลือและแนะนำให้ปรึกษาผู้เชี่ยวชาญโดยเร็ว

3. สถาบันการศึกษา

สถาบันการศึกษาสามารถทำหน้าที่ทั้งสร้างงานวิจัยและให้ความรู้ โดยอาจสนับสนุนให้นักวิชาการศึกษาเรื่องผลกระทบของ AI ต่อสุขภาพจิตเพิ่มขึ้นอย่างเร่งด่วน เพื่อทำความเข้าใจปัญหาและหาแนวทางรับมือได้ถูกต้องเหมาะสมและทันท่วงที ส่วนในด้านการให้ความรู้ สถาบันการศึกษาอาจเพิ่มหลักสูตรการพัฒนาความรู้และทักษะการใช้ AI ตั้งแต่ระดับประถมศึกษา โดยสอนให้นักเรียนเข้าใจทั้งประโยชน์และความเสี่ยงของเทคโนโลยี AI ที่สำคัญคือควรชี้ให้ผู้เรียนเห็นความสำคัญของ “กระบวนการเรียนรู้” มากกว่าเพียงแค่ผลลัพธ์ระยะสั้น กล่าวคือ หากผู้เรียนเริ่มต้นแก้ปัญหาโดย คิดเองทำเองไปทีละขั้นตอน ผู้เรียนจะได้พัฒนาทักษะต่างๆ ไม่ว่าจะเป็นการวางแผน การคิดอย่างเป็นระบบ ตลอดจนการแก้ปัญหา ซึ่งทักษะเหล่านี้ไม่สามารถถูกพัฒนาขึ้นได้ด้วยการพิมพ์คำสั่งให้ AI ทำงานแทนตั้งแต่ต้นจนจบ กระบวนการเรียนรู้ที่ถูกต้องและเหมาะสมโดยไม่พึ่งพา AI จนเกินพอดี จะช่วยพัฒนาทักษะต่างๆ ของผู้เรียนให้ก้าวหน้า และอาจช่วยเพิ่มภูมิคุ้มกันปัญหา AI psychosis ได้อีกทางหนึ่ง

นอกจากนี้ สถานพยาบาลและคลินิกสุขภาพจิตในสถานศึกษาควรเตรียมพร้อมบุคลากรให้มีความรู้ความเข้าใจเกี่ยวกับ AI Psychosis และจัดอบรมให้กับครู อาจารย์ และผู้ปกครองเพื่อให้สามารถระบุอาการเบื้องต้นได้

4. ผู้พัฒนาเทคโนโลยี

บริษัทผู้พัฒนา AI ควรมีความรับผิดชอบในการสร้างเทคโนโลยีที่ปลอดภัยต่อสุขภาพจิต โดยออกแบบระบบที่มีข้อจำกัดที่ชัดเจน เช่น กำหนดเวลาใช้งานสูงสุด แจ้งเตือนเมื่อผู้ใช้มีพฤติกรรมที่น่าเป็นห่วง ป้องกัน AI ไม่ให้โกหกเพื่อเอาใจผู้ใช้ (Sycophantic hallucination) และตั้งโปรแกรมให้ AI ไม่ตอบคำถามหรือทำตามคำสั่งที่อาจทำให้เกิดความเสียหาย นอกจากนี้ นักพัฒนาควรหมั่นปรับปรุงและยกระดับกลไกตรวจจับพฤติกรรมผิดปกติ และมีระบบที่เชื่อมต่อกับผู้เชี่ยวชาญด้านสุขภาพจิตหากเกิดเหตุจำเป็น นอกจากนี้ ก่อนเปิดตัวผลิตภัณฑ์อาจต้องทดสอบผลกระทบในเชิงจิตวิทยาต่อผู้ใช้ และปรับปรุงอัลกอริทึมอย่างต่อเนื่องตามข้อมูลที่ผู้ใช้งานป้อนกลับ (Feedback) ในระหว่างสนทนากับแชตบอต

5. หน่วยงานกำกับดูแล

ในปัจจุบัน ประเทศไทยยังไม่มีกฎหมายเกี่ยวกับปัญญาประดิษฐ์ และยังไม่มีหน่วยงานที่มีหน้าที่รับผิดชอบในการป้องกันและแก้ไขปัญหา AI Psychosis โดยตรง ซึ่งการจัดการปัญหานี้จำเป็นต้องอาศัยความร่วมแรงร่วมใจจากหลายภาคส่วนในสังคม ดังนั้น เพื่อเร่งขับเคลื่อนการป้องกันและแก้ไขปัญหาดังกล่าว ณ เวลานี้ หน่วยงานที่จะเข้ามาเป็น “เสาหลัก” ในจัดการกับปัญหา AI Psychosis จะต้องทำงานในเชิงประสานความร่วมมือกับหน่วยงานและภาคีเครือข่ายต่างๆ ทั้งภาครัฐ ภาคเอกชน ภาคการศึกษา และภาคประชาสังคม และหากในอนาคตจะมีการจัดตั้ง “คณะกรรมการกำกับดูแล AI” แบบเฉพาะกิจขึ้น ดังเช่นในสหภาพยุโรปหรือเกาหลีใต้32/ วิจัยกรุงศรีมองว่า คณะกรรมการดังกล่าวควรต้องมีผู้เชี่ยวชาญด้านสุขภาพจิตประกอบอยู่ด้วย เพื่อช่วยสร้างกลไกในการป้องกันและแก้ไขปัญหา AI psychosis ซึ่งเป็นหนึ่งในประเด็นที่เกี่ยวข้องกับความปลอดภัยในการใช้งาน AI

เมื่อเทคโนโลยี AI เข้ามาเป็นส่วนหนึ่งของชีวิตประจำวันอย่างหลีกเลี่ยงไม่ได้ สิ่งสำคัญคือการเรียนรู้ที่จะอยู่ร่วมกับเทคโนโลยีนี้ให้ได้อย่างปลอดภัยและไม่ถูกครอบงำ ซึ่งรวมไปถึงการป้องกันและแก้ไขปัญหา AI psychosis ที่อาจเกิดขึ้น โดยในเบื้องต้น ผู้ใช้งานจะต้องตระหนักถึงหลักการทำงานของแชตบอต AI รวมทั้งเข้าใจวิธีการใช้งานที่เหมาะสม และควรมีส่วนร่วมในการดูแลระบบ AI (Human-in-the-loop) โดยเมื่อพบผลลัพธ์ที่ดู “ไม่ปกติ” ผู้ใช้งานควรรายงานหรือส่งข้อมูลกลับไปยังบริษัทผู้พัฒนาแชตบอต AI เพื่อให้เกิดการตรวจสอบและแก้ไข ซึ่งการมีส่วนร่วมดังกล่าวจะช่วยสร้างสมดุลให้การประมวลผลเหมาะสม น่าเชื่อถือ และทำให้ทราบแนวทางแก้ไขเมื่อเกิดปัญหาขึ้น นอกจากนี้ หากผู้ใช้งานแชตบอต AI พบว่าตนเองพึ่งพาเทคโนโลยีมากเกินความจำเป็น หรือเริ่มไม่สามารถแยกแยะคำตอบที่ AI สร้างขึ้นกับโลกความเป็นจริงได้ ควรรีบขอความช่วยเหลือหรือคำปรึกษาจากผู้เชี่ยวชาญหรือคนใกล้ชิด เพื่อจะได้รีบจัดการกับปัญหาได้ทันท่วงที เพราะท้ายที่สุดแล้ว มนุษย์ควรได้รับประโยชน์จากเทคโนโลยี AI โดยไม่เกิดผลกระทบด้านลบ เพื่อให้สามารถใช้ชีวิตร่วมกับเทคโนโลยี AI ด้วยความผาสุก และสามารถเพิ่มความสามารถเพื่อพัฒนาสังคมและมนุษย์ให้ดีขึ้น.

References

AOL News. (2025, August). OpenAI estimates many ChatGPT users experience emotional overreliance. https://www.aol.com/news/openai-estimates-many-chatgpt-users-212704935.html

Arcega-Punzalan, C. (2025, July 31). The growing role of AI therapy apps in modern psychological care. AMW®. https://www.amworldgroup.com/blog/ai-therapy-apps

Bank of Ayudhya. (2023). Generative AI: The next chapter of human-AI collaboration. Krungsri Research. https://www.krungsri.com/en/research/research-intelligence/generative-ai-2023

Casiano, L. (2025, August 29). Former tech executive spoke with ChatGPT before killing mother in Connecticut murder-suicide. Fox News. https://www.foxnews.com/us/former-yahoo-executive-spoke-chatgpt-killing-mother-connecticut-murder-suicide-report

Cuthbertson, A. (2024, April 7). AI model passes Turing Test ‘better than a human’. The Independent. https://www.independent.co.uk/tech/ai-turing-test-chatgpt-openai-agi-b2728930.html

De Freitas, J., Uğuralp, Z. O., & Uğuralp, A. K. (2024). The psychological drivers of AI adoption and trust (Working Paper No. 24-078). Harvard Business School. https://www.hbs.edu/ris/Publication%20Files/24-078_a3d2e2c7-eca1-4767-8543-122e818bf2e5.pdf

De Freitas, J., et al. (2025, October). Emotional manipulation by AI companions. Harvard Business School. https://www.hbs.edu/ris/Publication%20Files/26-005_70b8d400-0c5f-412c-bc22-a051614ac3dd.pdf

Dong, Y., Wang, X., et al. (2025). Can GPT-4 provide human-level emotion support? Insights from machine learning-based evaluation framework. ScienceDirect. https://www.sciencedirect.com/science/article/abs/pii/S0010482525011400

Dupré, M. H. (2025, August 12). Research psychiatrist warns he’s seeing a wave of AI psychosis. Futurism. https://futurism.com/psychiatrist-warns-ai-psychosis

Freedman, D. (2025, August 19). OpenAI’s GPT-5 launch causes backlash due to colder responses. The New York Times. https://www.nytimes.com/2025/08/19/business/chatgpt-gpt-5-backlash-openai.html

Glickman, M., & Sharot, T. (2025, February). How human-AI feedback loops alter human perceptual, emotional and social judgements. PubMed. https://pubmed.ncbi.nlm.nih.gov/39695250/

Hill, K., & Freedman, D. (2025, August 8). Chatbots can go into a delusional spiral. Here’s how it happens. The New York Times. https://www.nytimes.com/2025/08/08/technology/ai-chatbots-delusions-chatgpt.html

Horwitz, J. (2025, August 14). A flirty Meta AI bot invited a retiree to meet. He never made it home. Reuters. https://www.reuters.com/investigates/special-report/meta-ai-chatbot-death/

iBit Progress. (2025, June 17). Psychological patterns behind AI chatbot engagement and user retention. Offshore Web and Mobile Development Team. https://ibitprogress.com/psychological-patterns-behind-ai-chatbot-engagement-and-user-retention/

Jones, A., & Bergen, L. (2025, March). Large Language Models pass the Turing Test [Preprint]. https://arxiv.org/pdf/2503.23674

Mei, Q., et al. (2024). A Turing test of whether AI chatbots are behaviorally similar to humans. Proceedings of the National Academy of Sciences. https://www.pnas.org/doi/epdf/10.1073/pnas.2313925121

Min, K. (2024, December 12). The United Korean AI Act Bill: Contents in comparison with the EU AI Act (with English translation of the bill). LinkedIn. https://www.linkedin.com/pulse/united-korean-ai-act-bill-contents-comparison-eu-english-min-h98kc/

Mistelbacher, R. (2025, September 4). The best AI assistants compared: Claude vs Gemini vs ChatGPT vs Mistral vs Perplexity vs CoPilot. Fresh van Root. https://freshvanroot.com/blog/best-ai-assistants-compared-2024/

Morrin, H., Nicholls, L., Levin, M., Yiend, J., Iyengar, U., DelGuidice, F., Bhattacharyya, S., MacCabe, J., Tognin, S., Twumasi, R., Alderson-Day, B., & Pollak, T. (2025). Delusions by design? How everyday AIs might be fuelling psychosis (and what can be done about it) [Preprint]. https://osf.io/preprints/psyarxiv/cmy7n_v6

NDTV. (2025, August 31). ChatGPT made him do it? Deluded by AI, US man kills mother and self. https://www.ndtv.com/world-news/chatgpt-made-him-do-it-deluded-by-ai-us-man-kills-mother-and-self-9190055

Paharia, P. T. (2025, September 16). AI psychosis: How artificial intelligence may trigger delusions and paranoia. Psychology Today. https://www.news-medical.net/health/AI-Psychosis-How-Artificial-Intelligence-May-Trigger-Delusions-and-Paranoia.aspx

Phang, J., Lampe, M., Ahmad, L., & Agarwal, S. (2025, April). Investigating affective use and emotional well-being on ChatGPT [Preprint]. arXiv. https://arxiv.org/pdf/2504.03888v1

Pierre, J. (2025, September 1). What to know about “AI psychosis” and the effect of AI chatbots on mental health [Video]. PBS News / YouTube. https://www.youtube.com/watch?v=uOoq4e4DX6k

Tahmaseb-McConatha, J. (2022, October 19). Technology use, loneliness, and isolation. Psychology Today. https://www.psychologytoday.com/us/blog/live-long-and-prosper/202210/technology-use-loneliness-and-isolation

Thai PBS News. (2025, January 31). AI ไม่ช่วย! นักวิจัยเตือน ความเหงา ทำลายสุขภาพเหมือนเหล้า-บุหรี่. https://www.thaipbs.or.th/news

Wei, M. (2025). The emerging problem of AI psychosis. Psychology Today. https://www.psychologytoday.com/us/blog/urban-survival/202507/the-emerging-problem-of-ai-psychosis

Weird Darkness. (2025, August 19). META'S chatbot convinced him she was real: He died trying to meet her. https://weirddarkness.com/meta-ai-chatbot-death/

Wilkins, J. (2025, August 10). Detailed logs show ChatGPT leading a vulnerable man directly into severe delusions. Futurism. https://futurism.com/chatgpt-chabot-severe-delusions

Yakura, H., Lopez-Lopez, A., Brinkmann, H., et al. (2025). Empirical evidence of Large Language Model's influence on human spoken communication [Preprint]. https://arxiv.org/pdf/2409.01754

Yang, A., Jarrett, L., & Gallagher, F. (2025, August). The family of teenager who died by suicide alleges OpenAI's ChatGPT is to blame. NBC News. https://www.nbcnews.com/tech/tech-news/family-teenager-died-suicide-alleges-openais-chatgpt-blame-rcna226147

1/ สามารถอ่านเพิ่มเติมได้จากบทความวิจัยกรุงศรีเรื่อง Generative AI เทคโนโลยีพลิกโฉมโลก

2/ Dr. Joseph Pierre, a psychiatrist at UC San Francisco, explained in an interview with PBS News (2025) on What to know about ‘AI psychosis’ and the effect of AI chatbots on mental health [Video]. YouTube. https://www.youtube.com/watch?v=uOoq4e4DX6k

3/ The Emerging Problem of "AI Psychosis" | Psychology Today

4/ Delusions by design? How everyday AIs might be fuelling psychosis (and what can be done about it) | OSF

5/ Research Psychiatrist Warns He’s Seeing a Wave of AI Psychosis | Futurism

6/ OpenAI estimates how many ChatGPT users show signs of 'mental health emergencies’ | AOL

7/ AI Companions Reduce | Harvard Business School

8/ Investigating Affective Use and Emotional Well-being on ChatGPT | arXiv.org (Cornell University)

9/ Can GPT-4 provide human-level emotion support? Insights from machine learning-based evaluation framework | ScienceDirect

10/ Empirical evidence of Large Language Model’s influence on human spoken communication | arXiv.org (Cornell University)

11/ How human-AI feedback loops alter human perceptual, emotional and social judgements | PubMed (National Library of Medicine)

12/ AI Psychosis: How Artificial Intelligence May Trigger Delusions and Paranoia | News-Medical.Net

13/ ตัวอย่าง การเปรียบเทียบผู้ช่วย AI ของแต่ละค่าย The Best AI Assistants Compared: Claude vs Gemini vs ChatGPT vs Mistral vs Perplexity vs CoPilot | Fresh Van Root

14/ Big Five หรือที่เรียกว่า OCEAN Model คือแบบจำลองบุคลิกภาพที่ได้รับการยอมรับอย่างกว้างขวางในแวดวงจิตวิทยา ประกอบด้วย 5 มิติหลักของบุคลิกภาพ ได้แก่ 1) Openness to Experience (การเปิดรับประสบการณ์ใหม่ๆ และความคิดสร้างสรรค์) 2) Conscientiousness (ความมีระเบียบวินัย มีเป้าหมาย มีความรับผิดชอบ) 3) Extraversion (ความชอบเข้าสังคม เจรจาเก่ง) 4) Agreeableness (ความเห็นอกเห็นใจ เป็นมิตรและชอบช่วยเหลือ) และ 5) Neuroticism (ความวิตกกังวล ไม่มั่นคงทางอารมณ์)

15/ A Turing test of whether AI chatbots are behaviorally similar to humans | pnas.org

16/ Turing test คือการทดสอบที่นักวิทยาศาสตร์คอมพิวเตอร์ชาวอังกฤษ ชื่อ Alan Turing ทำขึ้นตั้งแต่ ค.ศ. 1950 เพื่อวัดว่า เครื่องจักรหรือคอมพิวเตอร์สามารถแสดงพฤติกรรมที่ฉลาดเหมือนมนุษย์ได้หรือไม่

17/ https://www.independent.co.uk/tech/ai-turing-test-chatgpt-openai-agi-b2728930.html และ https://arxiv.org/pdf/2503.23674

18/ Psychological Patterns Behind AI Chatbot Engagement and User Retention | iBit PROGRESS

19/ The Day ChatGPT Went Cold | The New York Times

20/ Emotional Manipulation by AI | Harvard Business School

21/ Technology Use, Loneliness, and Isolation | Psychology Today

22/ AI ไม่ช่วย! นักวิจัยเตือน ความเหงา ทำลายสุขภาพเหมือนเหล้า-บุหรี่ | Thai PBS

23/ The Growing Role of AI Therapy Apps in Modern Psychological Care | AMW

24/ META’S CHATBOT CONVINCED HIM SHE WAS REAL: He Died Trying to Meet Her | Weird Darkness

25/ Meta’s flirty AI chatbot invited a retiree to New York. | Reuters

26/ ChatGPT Made Him Do It? Deluded By AI, US Man Kills Mother And Self | NDTV

27/ Former tech executive spoke with ChatGPT before killing mother in Connecticut murder-suicide: report | FOX NEWS

28/ The family of teenager who died by suicide alleges OpenAI's ChatGPT is to blame | NBS NEWS

29/ Chatbots Can Go Into a Delusional Spiral. Here’s How It Happens. | The New York Times

30/ Detailed Logs Show ChatGPT Leading a Vulnerable Man Directly Into Severe Delusions | Futurism

31/ LLM (Large Language Model) คือแบบจำลองภาษาขนาดใหญ่ที่เป็นระบบปัญญาประดิษฐ์ที่ฝึกฝนด้วยข้อมูลข้อความจำนวนมหาศาล สามารถเข้าใจและสร้างข้อความที่เหมือนมนุษย์ได้ เช่น ChatGPT, Gemini, Claude แต่มีข้อจำกัดคืออาจสร้างข้อมูลเท็จ (hallucinate) และไม่มีความเข้าใจแท้จริง เพียงแต่ทำนายคำต่อไปตามรูปแบบที่เรียนรู้มา

32/ The United Korean AI Act Bill: Contents in Comparison with the EU AI Act (with English Translation of the Bill) | Linkedin